Shadow AI: i rischi aziendali di mancato governo dell’intelligenza artificiale

Il fenomeno che nessun responsabile HR vorrebbe ammettere

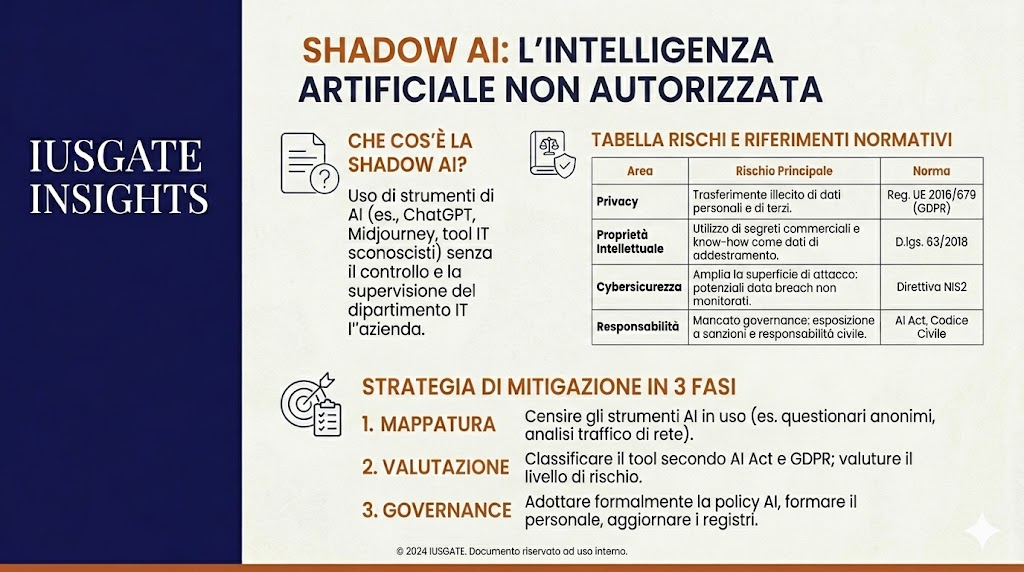

C’è un fenomeno che sta crescendo silenziosamente in quasi ogni azienda italiana: i dipendenti che usano strumenti di intelligenza artificiale non approvati per svolgere il loro lavoro: un contratto da revisionare caricato su ChatGPT, un’analisi di bilancio elaborata con un AI personale, una presentazione per il cliente generata con uno strumento mai visto dall’IT aziendale. Questo è il fenomeno detto in gergo “Shadow AI”: l’uso di sistemi AI al di fuori di qualsiasi autorizzazione, supervisione, policy o controllo aziendale.

Il termine rientra nel concetto di “Shadow IT” — il ricorso a software e dispositivi non autorizzati — con implicazioni ben più gravi. Perché l’intelligenza artificiale non si limita a elaborare dati: li apprende, potrebbe archiviarli e utilizzarli anche per addestrare modelli AI. E quando quei dati riguardano clienti, dipendenti o strategie aziendali, il danno può essere irreversibile.

Perché lo Shadow AI prolifera

La risposta è scomoda: perché funziona. Gli strumenti AI consumer sono rapidi, gratuiti o quasi, intuitivi. Il dipendente che usa ChatGPT per redigere una email complessa risparmia tempo — e lo sa. In assenza di alternative aziendali adeguate o di una formazione specifica, il ricorso allo Shadow AI diventa una scelta razionale dal punto di vista operativo. Una recente ricerca di Microsoft e LinkedIn ha rilevato che oltre il 75% dei lavoratori che usano strumenti AI li porta autonomamente sul lavoro, spesso senza informare il proprio datore di lavoro. La stessa ricerca evidenzia che molti di questi utenti scelgono di non rivelare l’utilizzo dell’AI per timore di ripercussioni negative. Nasce così un doppio registro: quello ufficiale — che dichiara procedure, strumenti approvati e flussi di controllo — e quello reale, in cui l’AI entra dai canali laterali.

I rischi concreti per l’impresa Sul piano privacy e GDPR, il rischio è immediato. Caricare dati personali di dipendenti, clienti o partner su piattaforme AI di terze parti non autorizzate può costituire, nella maggior parte dei casi, un trasferimento illecito di dati ai sensi del Regolamento (UE) 2016/679. Il Garante italiano ha già avviato procedimenti su casi analoghi — basti ricordare il provvedimento d’urgenza nei confronti di OpenAI del 2023 — e le sanzioni possono arrivare fino al 4% del fatturato mondiale annuo. Sul piano della proprietà intellettuale e di segreto aziendale/commerciale, i contenuti inseriti nei tool AI possono diventare dati di addestramento di modelli accessibili a terzi. Piani strategici, listini prezzi, bozze contrattuali: tutto ciò che viene caricato potrebbe, in alcuni scenari, non rimanere riservato. Sul piano della cybersicurezza, lo Shadow AI amplia la superficie di attacco aziendale. Ogni strumento non monitorato è un potenziale vettore di data breach, soprattutto in assenza di autenticazione aziendale e di log di accesso.

Riepilogo dei principali rischi

L’AI Act e il quadro normativo: cosa è cambiato per le imprese

Va ricordato che l’AI Act europeo (Regolamento UE 2024/1689), in vigore dall’agosto 2024 e applicabile progressivamente fino ad arrivare al 2026, introduce obblighi precisi per chi usa sistemi AI — non solo per chi li sviluppa. Le imprese che impiegano strumenti AI classificati ad alto rischio devono garantire supervisione umana, trasparenza e documentazione adeguata. Usare uno strumento AI non autorizzato significa, nella maggior parte dei casi, usarlo senza avere la minima contezza della sua classificazione di rischio.

A ciò va aggiunto quanto introdotto dalla normativa italiana sull’AI (Legge 23 settembre 2025, n. 132), in vigore dal 10 ottobre 2025: prima legge nazionale organica sull’intelligenza artificiale. Imponendo un utilizzo dell’AI antropocentrico, trasparente e responsabile, con garanzie di tracciabilità dei processi e obbligo che la decisione finale resti sempre in capo a una persona fisica. Per le imprese, il messaggio è diretto: muoversi in assenza di regole interne sull’uso dell’AI non è più una zona grigia — è un’esposizione a un doppio livello di responsabilità, europeo e nazionale.

Parallelamente, è pendente una proposta di Direttiva sulla responsabilità da AI che mira a facilitare il risarcimento del danno causato da sistemi AI, con presunzione di nesso causale a carico dell’utilizzatore. In questo scenario, l’impresa che non riuscisse a dimostrare di aver adottato misure di governance adeguate sugli strumenti AI in uso — compreso il monitoraggio dello Shadow AI — si troverebbe in una posizione processuale particolarmente vulnerabile.

La policy AI aziendale ormai non è un optional

La risposta strutturale allo Shadow AI non è il divieto assoluto — spesso inefficace e controproducente — quanto la governance. Una policy AI aziendale ben costruita serve a tre scopi: delimitare i confini dell’uso lecito, responsabilizzare i dipendenti, proteggere l’azienda in caso di contestazioni.

Una policy efficace dovrebbe disciplinare almeno i profili di censimento dei tool, di classificazione dei dati utilizzabili, di gestione degli output, ecc.

Attenzione: la policy deve anche essere adeguatamente comunicata, internamente e a fornitori pertinenti, inserita nel sistema disciplinare aziendale per avere piena efficacia sul piano giuslavoristico. Una policy adottata però non correttamente diffusa ha lo stesso valore pratico di un’assenza di policy.

Cosa fare subito: un approccio in tre fasi

Fase 1 — Mappatura: censire gli strumenti AI effettivamente in uso in azienda, anche tramite questionari anonimi o analisi del traffico di rete. Senza una fotografia reale, qualsiasi policy sarà inutile.

Fase 2 — Valutazione del rischio: classificare gli strumenti rilevati perlomeno secondo i criteri dell’AI Act e del GDPR. Per ciascuno valutare se i dati trattati rientrano nelle categorie protette.

Fase 3 — Governance: adottare formalmente la policy AI, formare il personale, aggiornare il registro dei trattamenti GDPR e — ove necessario e opportuno — nominare un responsabile interno per la governance AI.